東京・砧のNHK放送技術研究所では、本日(5月29日)から6月1日までの4日間、恒例の「技研公開2025」を開催中だ。

今年のテーマは「広がる つながる 夢中にさせる」で、「イマーシブメディア」「ユニバーサルサービス」「フロンティアサイエンス」「メディアを支える」の4カテゴリー・18の研究成果や体験展示が行われている。Stereo Sound ONLINEも、先日開催されたプレス体験会に参加してきたので、以下で今回の見どころを紹介したい。

1.イマーシブメディア

ARグラスを使ったイマーシブ体験のデモ

体感リモコンはグリップ部分にペルチェ素子が埋め込まれており、温度変化も表現できる。上部からは匂いも

体感リモコンを画面に向けることでグラフィックの操作も可能

エントランスを入った正面のステージでは、「広がるコンテンツ体験」のデモが行われている。そのひとつはAR(拡張現実)グラスを使ったイマーシブ体験で、離れた場所にいる友達と一緒に同じ番組を見ているような体験ができたり(アバターがARグラスに表示される)、ジェスチャー動作でコンテンツの巻き戻しや早送りができるというものだ。

さらにもうひとつ、体感リモコンと呼ばれるデバイスを使った3Dコンテンツ体験も提案されている。体感リモコンを持った状態で画面に映し出されるかき氷を手に取ると、指の当たる部分が冷たくなったり(この部分にペルチェ素子が取り付けられている)、あるいは体感リモコンの上部からいちごシロップの匂いが漂うといった仕組みだ。

このふたつはどちらもステージ横のブースで実際に体験できるので、会場に出かけた方はぜひお試しいただきたい。

2.ユニバーサルサービス

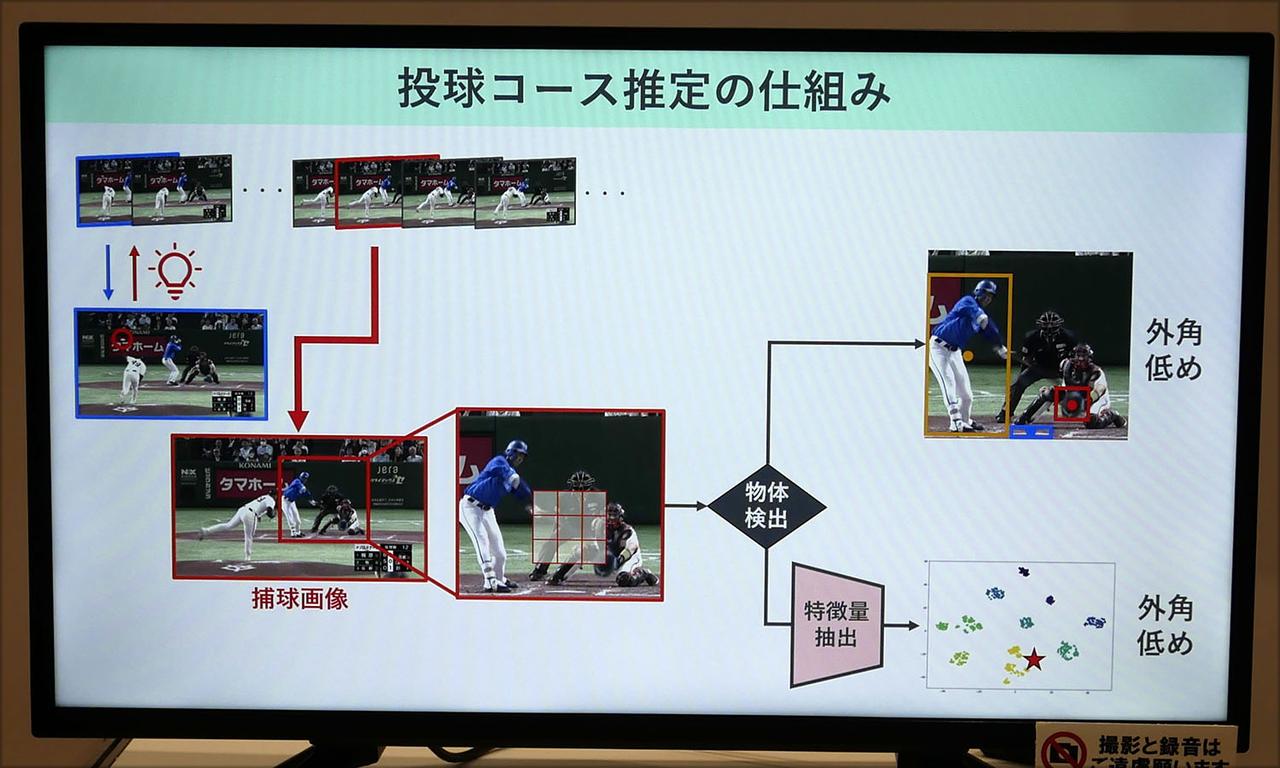

投球コースや球種の判定にはそれぞれ専用のAIを使っているとか

音楽の視覚化のデモ画面。上のバーが曲の進行やテンポを、左が量感を示している

その隣では、視覚や聴覚に障害のある方や、高齢者、外国人などのあらゆる人が情報を共有できるようにすることを目指した「つながるアクセサビリティー体験」の展示も並んでいる。その中でユニークだったのは、スポーツ中継の解説音声制作技術だろう。

ここでは、AIを使って映像から投手のフォームや球種、投球コースを識別、さらに戦略分析まで行ってくれる。同時に顔認識AIを使って画面に写っている選手の状態も紹介できるという。しかもこれらを字幕、音声読み上げ、手話といった方法で再現可能とのことだ。

もうひとつ、昨年麻倉怜士さんの連載で紹介した「音楽の視覚化技術」も具体化されている。これは聴覚に障害のある方にも音楽を楽しんでもらいたいという思いから開発されたもので、昨年は音の変化を図形で表現していたが、今回は音程やテンポを横方向のバーなどで表示するように工夫が施されていた。

3.イマーシブメディア体験

ドーム状のスクリーンに15Kの映像を投写

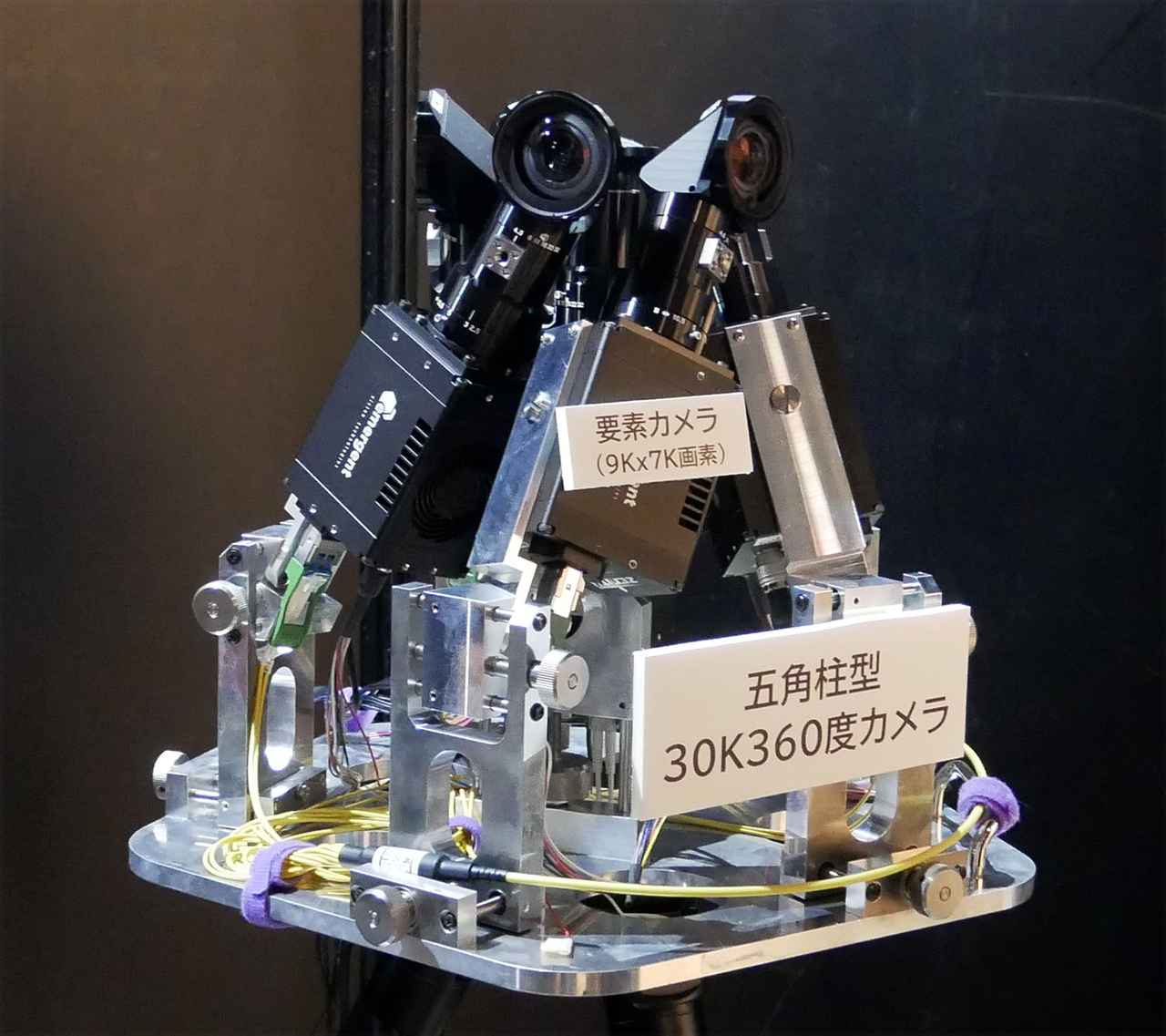

6台のカメラを組み合せて合計30K/360度の撮影を実現

30Kのカメラで撮影した映像を、半球状のスクリーン(直径3m、床面積4×4m)にプロジェクター投写する没入大画面&マルチチャンネル音響も楽しい展示だ。

9K×7Kの撮影が可能なカメラ(市販品)を水平方向に5台上向きに1台の、合計6台を組み合せて映像を撮影し、それぞれの画像を合成することで30Kの解像度を備えたデータを作成するとのことで、今回はその半分の画像をドーム状のスクリーンに投射している(魚眼レンズを使用)。プロジェクターは8K解像度を持ったモデルで、画素ずらしを行なうことで15K相当の投写を実現したそうだ。

飛行機が前方から飛んできて頭上を通過する様子や、壁一面に並んだ本棚を俯瞰する映像などが上映されていたが、確かにスクリーンに引き込まれるかのような没入感が体験できた。組み合わせられた19chサラウンドも映像に寄り添っており、臨場感再現に一役かっていた。

4.湾曲イメージセンサー

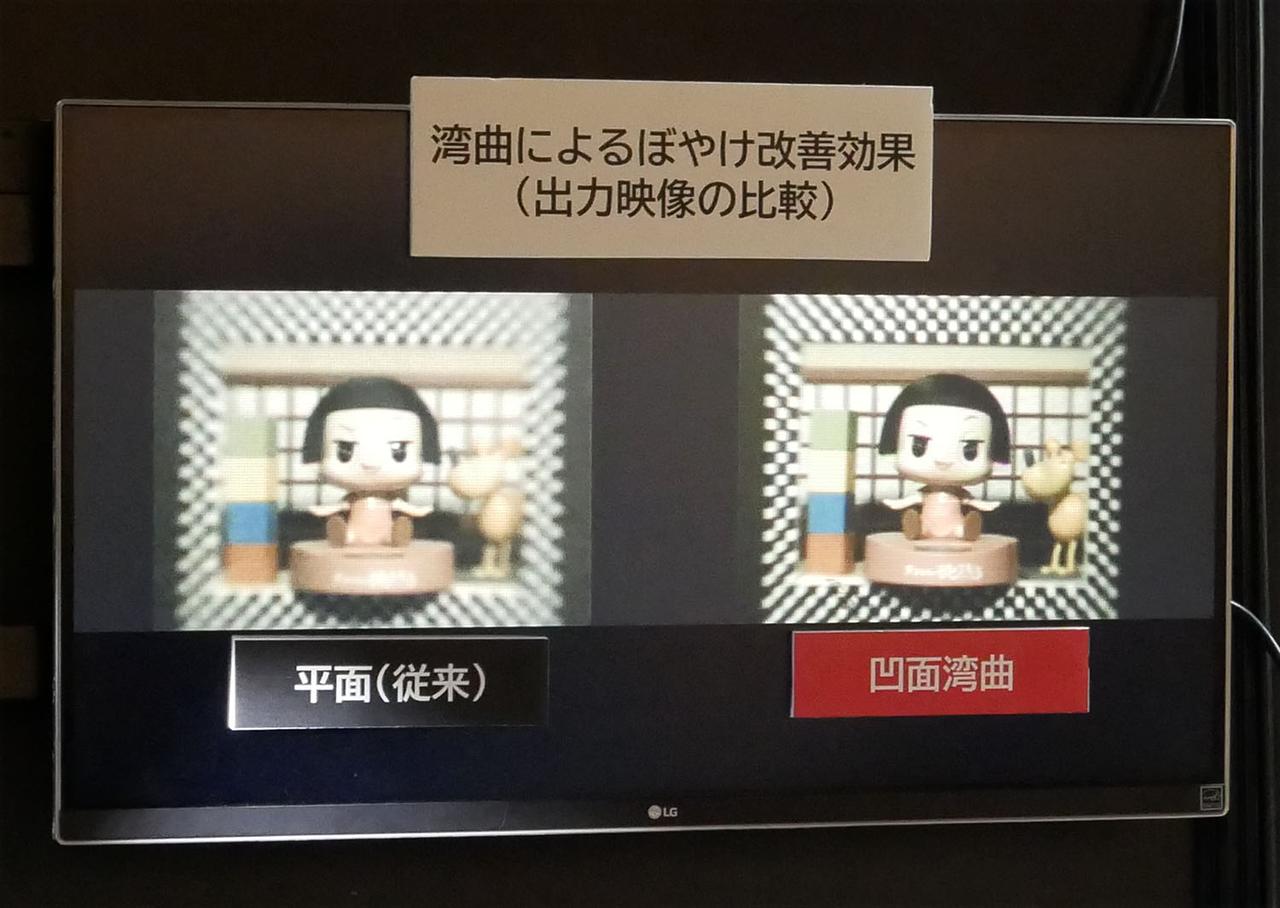

湾曲イメージセンサーを使った撮影のデモ。周辺のぼやけが抑えられているのがわかる

1台で180度の撮影が可能なデバイスも検討されている

これまで平面だったカメラのイメージセンサーを凹型形状にすることで、映像の周辺ぼやけを改善しようという研究も展示。シリコンイメージセンサーを0.01mmまで薄くすることで曲面を実現した。このイメージセンサーを使えばレンズの収差も抑えられるという。

もうひとつ、同じく薄型イメージセンサーを横方向に複数個並べ、それそれを小型レンズと組み合せることで、180度のパノラマ映像を撮影しようという技術も提案されている。複数台のカメラを並べてパノラマ撮影する方法もあるが、それでは各カメラの物理的な位置を合わせるのが難しかった。この方式であれば一台のカメラに格納できるので、より手軽に美しい横長映像が撮影できるだろう。

5.ディフォーマブルディスプレイ

水平64×垂直32個のLEDを備える。LEDを間のピッチも4mmまで狭くなっっている

改良された伸縮配線

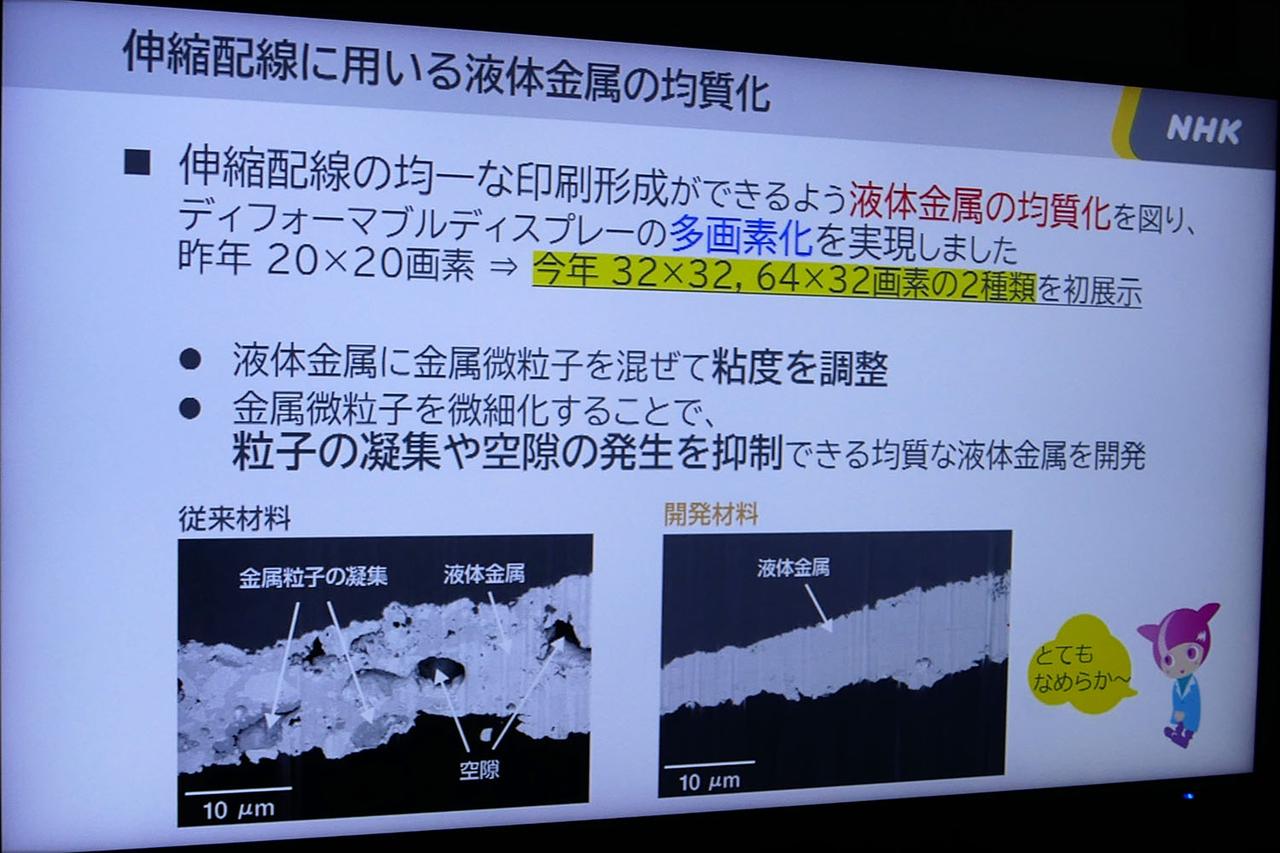

数年前からNHK技研公開で発表されてきた、曲げられる表示デバイスもさらに進化している。ゴムの基板上にLEDを取り付け、伸縮性を備えた液体金属を配線に使うことで自由な形に変化できるようになっている。

さらに今年は液体金属に金属粒子を配合して粘度を調整し、印刷に適した配線パターンを開発している。この結果、配線の間隔を詰めることができ、LEDのピッチも狭くなることでディスプレイとしての解像度も向上したそうだ。

また金属配線の抵抗を感知するセンサーも搭載、現在どれくらい引き伸ばされているかを判別して絵柄を自動調整する機能も備えている。これによりディスプレイを横に引き伸ばした時に人の顔が伸びてしまう、といったことも避けられるようだ。

12.縦型画面自動切り出し技術

スマホの縦型画面にあった映像を簡単に制作できるプログラムも開発されている

昨今、スマホでの視聴が増えていることを踏まえ、ニュース映像を縦型画面でも違和感なく表示できる編集技術も提案されている。そこでは単純に画面中央を切り出すのではなく、メインとなる被写体のサイズに併せて映像を切り出したり、必要に応じてパンニングなどの処理も可能という。さらにそれらの編集作業を簡単な操作で行えるアプリも開発中とのことだ。

15.マルチレイヤー対応VVCライブエンコーダー

リアルタイムVVCエンコーダー

VVCを使って10Mbpsで圧縮した映像。左がリアルタイム処理で、右は時間をかけた場合。奥に見える電光掲示板の文字の緻密さなどに差が出ていた

VVC(バーサタイル・ビデオ・コーディング)の機能を生かし、ベースとなる映像と字幕、緊急速報などを別々のレイヤーとして伝送、受信機側でどのレイヤーを再生するか選ぶことも可能になるという。例えば現在は、緊急速報が入った番組を録画すると、後で再生してもそのままの状態だが、VVCマルチレイヤー放送なら本編だけを楽しむことができるようになるだろう。

画質のメリットもある。例えばドラマのような事前に完パケができあっている番組についても、現在は緊急速報が入る可能性があるためリアルタイムエンコーダーを使って送出している。しかしVVCマルチレイヤー放送ならドラマ部分は事前に最適なパラメーター圧縮できるので(2パス、3パスも可能とのこと)、結果として画質向上が実現できるという。

18.シーン適応型カメラ

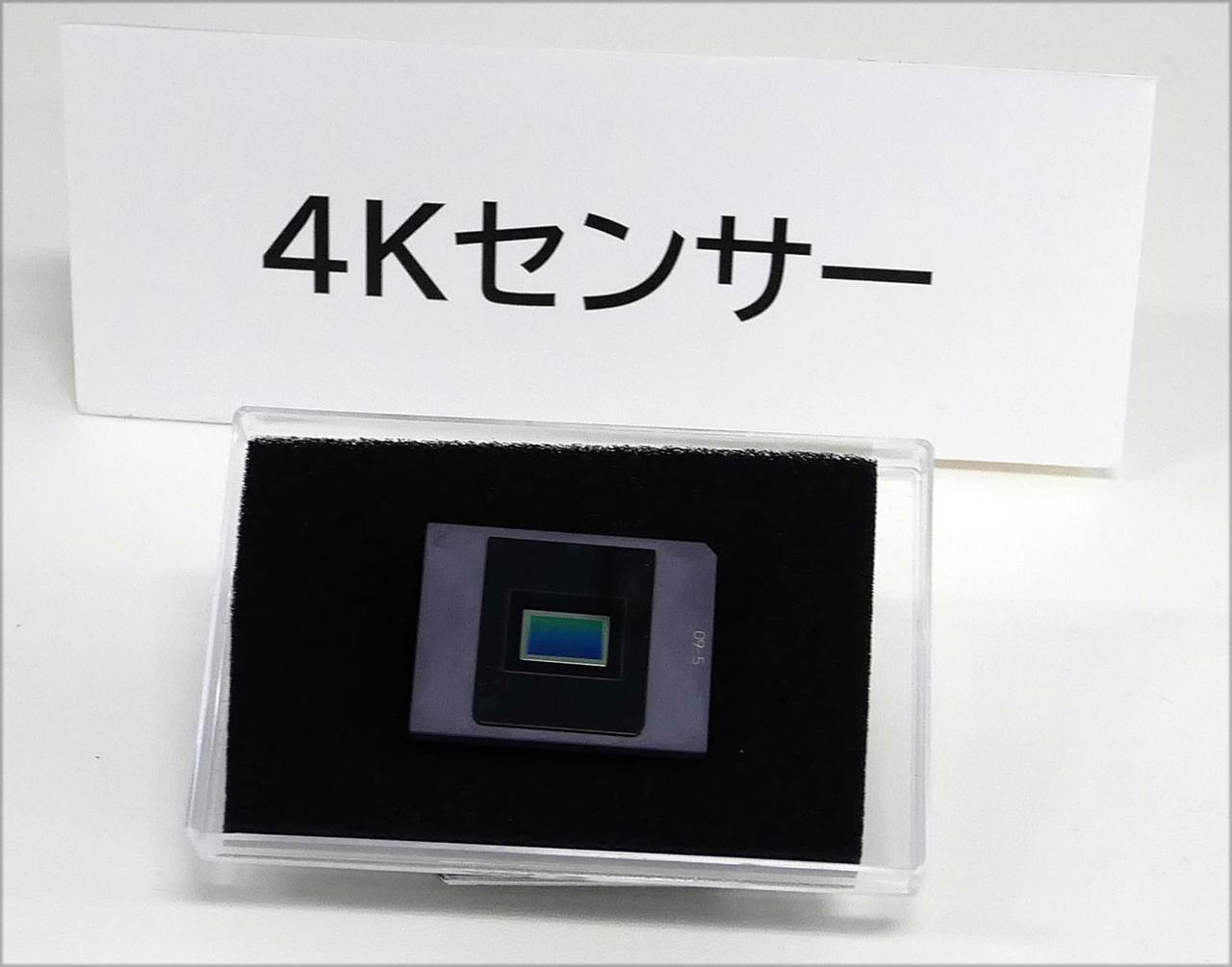

シーン適応型イメージセンサーが4K解像度に進化

現在どの状態で撮影を行っているかを表示

こちらは2023年の技研公開で展示されていた「シーン適応型イメージング技術」の最新版で、当時の麻倉怜士さんの連載でも紹介している。今回は解像度も1Kから4Kに進化、カラー映像の撮影も可能になっている。

さらに2023年の段階では制御ブロックは最小32×32画素だったが、今回は4×4画素まで微細化、このエリアごとに異なる解像度やフレームレート、露光時間を変えて撮影できるようになっている。